Inteligjenca Artificiale nuk ka të bëjë vetëm me ChatGPT, shkruan The Economist

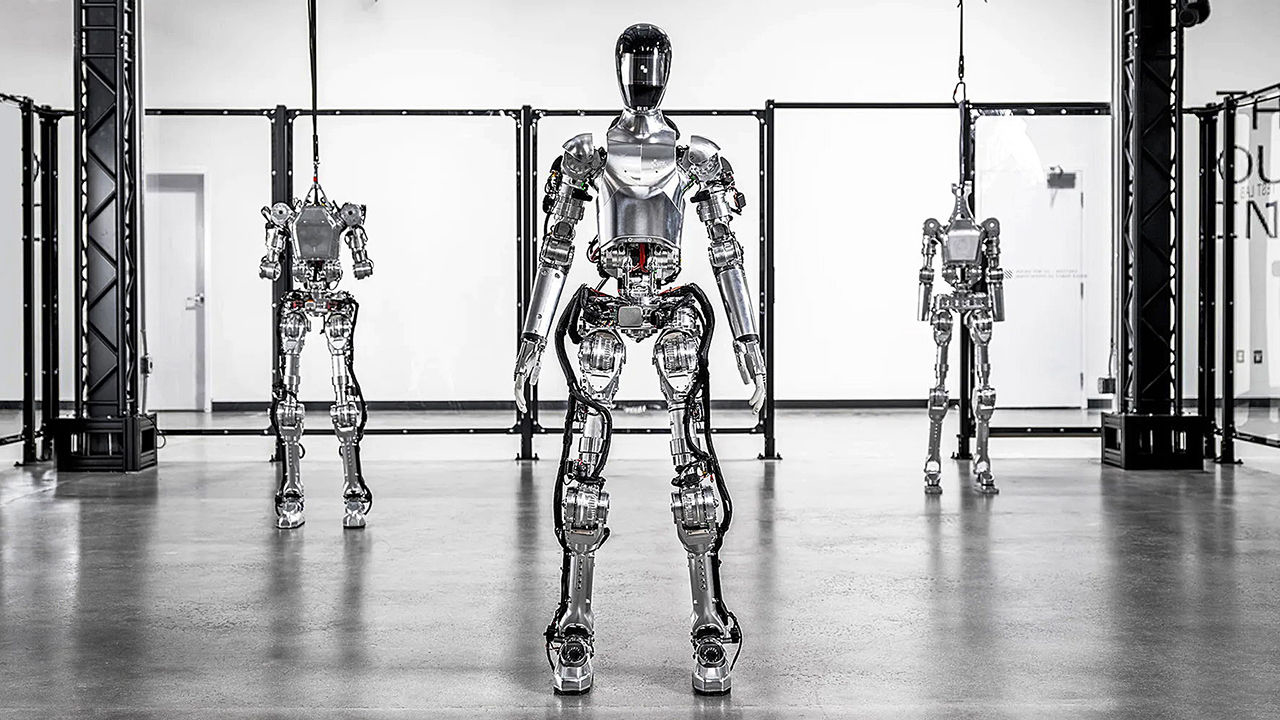

“Çfarë shihni tani?” një burrë pyet një robot humanoid që qëndron pas një tavoline. “Unë shoh një mollë të kuqe në një pjatë në qendër të tryezës, një tabaka me gota dhe një pjatë bosh, dhe ju që qëndroni afër, me dorën tuaj në tryezë”, përgjigjet roboti.

“Shkëlqyeshëm. A mund të kem diçka për të ngrënë?” thotë njeriu. “Sigurisht”, përgjigjet roboti. Përkul krahët, merr mollën me dorën e djathtë, e kalon në dorën e majtë dhe më pas ia jep burrit. Ai i kërkon robotit të shpjegojë veprimet e tij.

“Unë ju dhashë mollën, sepse është i vetmi artikull i ngrënshëm që mund t’ju ofroj nga tavolina”, përgjigjet roboti.

Kjo video e publikuar në mars nga kompania robotike startup Figure, shkaktoi habi të madhe. Ajo tregon një robot që mund të bisedojë, të njohë dhe të zhvendosë sende, të zgjidhë probleme dhe të shpjegojë veprimet e veta. Firma Figure nuk është e vetmja që ka dhënë rezultate kaq mbresëlënëse. Pas disa vitesh përparimi të ngadaltë, papritur duket se robotët po bëhen shumë më të zgjuar.

Çfarë ndryshoi?

Përbërësi magjik është Inteligjenca Artificiale. Studiuesit akademikë, kompanitë startup dhe gjigantët e teknologjisë, po bëjnë përparime në fushën e Inteligjencës Artificiale, si me modelet e mëdha gjuhësore (LLM), sintezën e të folurit dhe njohjen e imazheve, duke i zbatuar ato më pas në robotikë.

Modelet e mëdha gjuhësore mund të fuqizojnë chatbot-e si aplikacioni ChatGPT, por ato gjithashtu mund të fuqizojnë edhe robotët e vërtetë. “Algoritmet mund të shndërrohen”, thotë Peter Chen, drejtuesi ekzekutiv i firmës startup Covariant, me seli në Emeryville, Kaliforni. “Kjo po fuqizon rilindjen e robotikës”.

Roboti në video kishte aftësi të njohjes dhe të folurit, që ishin mundësuar nga firma e Inteligjencës Artificiale OpenAI, e cila është investitore në firmën Figure. OpenAI mbylli njësinë e vet të robotikës rreth vitit 2020, duke parapëlqyer që të investonte në firmën Figure dhe firma të tjera startup.

Por tani OpenAI ka ndryshuar mendim, dhe muajin e kaluar nisi të ndërtojë një ekip të ri robotik. Kjo është shenjë se ndjenjat kanë filluar të ndryshojnë.

Një hap kyç drejt zbatimit të Inteligjencës Artificiale te robotët, ishte zhvillimi i modeleve “multimodale”. Këto janë modele të Inteligjencës Artificiale të trajnuar në lloje të ndryshme të dhënash. Për shembull, një model gjuhësor është trajnuar, duke përdorur shumë tekst, ndërsa “modelet e gjuhës së vizionit” trajnohen duke përdorur edhe ndërthurje imazhesh (të palëvizshme ose në lëvizje) në harmoni me përshkrimet tekstuale përkatëse.

Kështu, modele të tilla mësojnë marrëdhënien midis të dyjave, duke u lejuar atyre që t’i përgjigjen pyetjeve rreth asaj çfarë po ndodh në një foto ose video, ose të krijojnë imazhe të reja duke u mbështetur në kërkesat e tekstit.

Modelet robotike VLAM

Modelet e reja që përdoren në robotikë, e çojnë këtë ide një hap më larg. Këto “modele vizion-gjuhë-veprim” (VLAM), marrin tekst dhe imazhe, plus të dhëna në lidhje me praninë e robotit në botën fizike, duke përfshirë të dhënat në sensorët e brendshëm, shkallën e rrotullimit të nyjeve të ndryshme dhe pozicionet (si gishtat e duarve të një roboti). Për rrjedhojë, këto modele mund t’u përgjigjen pyetjeve në lidhje me një skenë të caktuar, për shembull, pyetjes “a mund të shihni një mollë?” Por ato gjithashtu mund të parashikojnë se si duhet të lëvizë një krah robotik, për ta marrë atë mollë, dhe si do të ndikojë kjo në mjedisin rrethues.

Me fjalë të tjera, një model VLAM, mund të veprojë si një “tru” për robotët me të gjithë llojet e trupave, qofshin krahë gjigantë të palëvizshëm në fabrika apo magazina, apo robotë të lëvizshëm me këmbë ose rrota.

Dhe ndryshe nga modelet e mëdha gjuhësore, të cilat përdorin vetëm tekstin, modelet VLAM duhet të përshtasin së bashku disa të dhëna të ndryshme nga bota e jashtme, qoftë në formë teksti, imazhesh ose lexime me sensorë. Në këtë mënyrë, perceptimi i botës reale ul shumë shanset për halucinacione (që quhet prirja që kanë modelet e mëdha gjuhësore për të sajuar gjëra ose për të bërë gabime).

Covariant, kompania e doctor Chen, ka krijuar një model të quajtur RFM-1, i cili është trajnuar, duke përdorur tekste, imazhe dhe të dhëna nga më shumë se 30 lloje robotësh.

Softueri i tij përdoret edhe nga robotët automatikë në magazina dhe qendra shpërndarjeje, të vendosura në zonat periferike ku toka është e lirë, por puna e pakët. Kompania Covariant nuk prodhon asnjë nga pajisjet robotike, por përdoret softueri për të përmirësuar “trurin” e robotëve.

“Parashikojmë se inteligjenca e robotëve do të përmirësohet me rritjen e shpejtësisë së softuerit, sepse kemi mundësuar shumë më tepër të dhëna nga të cilat roboti mund të mësojë”, thotë doktor Chen. Përdorimi i këtyre modeleve të reja për të kontrolluar robotët, ka disa përparësi ndaj qasjeve të mëparshme, thotë Marc Tuscher, bashkëthemelues i firmës robotike startup Sereact, me seli në Shtutgart.

Një nga përfitimet është të mësuarit “zero-shot”, që në zhargonin teknologjik, nënkupton aftësinë për të bërë diçka të re, si për shembull, të ndjekësh urdhrin “për të marrë frutën me ngjyrë të verdhë”, pa u trajnuar në mënyrë të qartë për ta bërë këtë. Natyra multimodale e modeleve VLAM i ka bërë robotët shumë më të aftë për të perceptuar botën e jashtme, si për shembull, për të ditur faktin që bananet janë një lloj frute dhe që kanë ngjyrë të verdhë.

Bisedë me robotët

Një përfitim tjetër i modeleve të reja, është “të mësuarit në kontekst”, që në gjuhën teknologjike nënkupton aftësinë për të ndryshuar sjelljen e një roboti, duke përdorur kërkesat me tekst, në vend të riprogramimit të përpunuar. Doktor Tuscher jep si shembull një robot magazine që është programuar për të renditur pako, por që hutohej kur kutitë e hapura po vendoseshin gabimisht në sistem. Më parë, në mënyrë që roboti t’i shpërfillte këto kuti, ai duhej riprogramuar.

“Ndërsa tani mjafton t’i japim një urdhër me tekst për të mos marrë parasysh kutitë e hapura dhe roboti zgjedh vetëm kutitë e mbyllura”, thotë doktor Tuscher. “Ne mund të ndryshojmë sjelljen e robotit tonë, thjesht duke i dhënë një urdhër, gjë që është çmenduri”. Robotët mund të programohen nga njerëz jospecialistë, duke përdorur gjuhën e zakonshme, në vend të kodit kompjuterik.

Modele të tilla edhe mund të përgjigjen. “Kur roboti bën një gabim, ju mund ta pyesni dhe ai përgjigjet në formë teksti”, thotë doktor Chen. Kjo është e dobishme për korrigjimin e gabimeve, sepse më pas mund të jepen udhëzimet e reja që ndryshojnë sjelljen e robotit, thotë doktor Tuscher.

“Mund t’i thuash robotit, ‘kjo është gabim, të lutem bëje ndryshe në të ardhmen”. Kjo e bën më të lehtë punën me robotët për ata njerëz që nuk janë specialistë.

Të jesh në gjendje të pyesësh një robot se çfarë po bën dhe pse, është veçanërisht e dobishme në fushën e makinave me vetëdrejtim, të cilat në thelb janë një formë roboti. Firma Wayve, një startup i automjeteve autonome me seli në Londër, ka krijuar një model VLAM të quajtur Lingo-2. Përveç kontrollit të makinës, modeli mund të kuptojë komandat me tekst dhe të shpjegojë arsyetimin pas çdo vendimi. “Ai mund të japë shpjegime gjatë drejtimit të makinës dhe na lejon të korrigjojmë gabimet, t’i japim udhëzime sistemit, ose të ndryshojmë sjelljen e tij për të ndjekur një stil të caktuar”, thotë Alex Kendall, bashkëthemeluesi i firmës Wayve.

Ai për shembull thotë se modelit mund t’i bëhet pyetja se sa është kufiri i shpejtësisë dhe cilat shenja mjedisore (si shenjat rrugore) ka përdorur makina. “Ne mund të kontrollojmë se çfarë lloj konteksti mund të kuptojë roboti dhe çfarë mund të shohë”, thotë ai. Ashtu si me format e tjera të Inteligjencës Artificiale, qasja në sasi të mëdha të të dhënave të trajnimit është me rëndësi thelbësore.

Firma Covariant, e themeluar në vitin 2017, ka mbledhur të dhëna për shumë vite, të cilat i përdori për të trajnuar modelin robotik RFM-1. Robotët gjithashtu mund të udhëzohen manualisht për të kryer një detyrë të caktuar disa herë, dhe modeli më pas mund të bëjë përgjithësime nga të dhënat që rezultojnë. Ky proces njihet si “të mësuarit imitues”. Por kjo nuk është e vetmja mundësi. Një projekt i zgjuar kërkimor në Universitetin Stanford, i quajtur Mobile Aloha, gjeneroi të dhëna për t’i mësuar një roboti detyra të thjeshta shtëpiake, si përgatitja e kafesë, duke përdorur një proces të njohur si teleoperacion, që në thelb, nënkupton imitimin.

Studiuesit qëndruan pas robotit dhe i lëvizën gjymtyrët e tij drejtpërdrejt, duke i mundësuar atij të ndiejë, të mësojë dhe më pas të përsërisë një grup të caktuar veprimesh. Ata thonë se kjo qasje “i lejon njerëzit që t’u mësojnë robotëve aftësi arbitrare”. Investitorët po tregojnë interes. Chelsea Finn, profesor në Stanford që mbikëqyri projektin Mobile Aloha, është edhe një nga bashkëthemeluesit e firmës Physical Intelligence, një startup që së fundmi grumbulloi 70 milionë dollarë nga mbështetësit, përfshirë firmën OpenAI.

Firma robotike startup Skild, e krijuar nga Universiteti Carnegie Mellon, mendohet se ka grumbulluar 300 milionë dollarë në prill. Kompania Figure, e cila përqendrohet te robotët humanoidë, grumbulloi 675 milionë dollarë në shkurt. Firma Wayve grumbulloi 1.05 miliardë dollarë në maj, raundi më i madh i financimit i kryer ndonjëherë për një startup europian të Inteligjencës Artificiale. Doktor Kendall nga kompania Wayve, thotë se interesi në rritje për robotët, pasqyron zhvillimin e Inteligjencës Artificiale, pasi përparimi në softuerin e Inteligjencës Artificiale, po zbatohet gjithnjë e më shumë në harduerin që ndërvepron me botën reale.

“Inteligjenca Artificiale është shumë më tepër sesa chatbot-et”, thotë ai. “Në disa dekada, kur njerëzit do të mendojnë për Inteligjencën Artificiale, gjëja e parë që do t’u vijë në mendje, do të jenë pikërisht robotët që ndërveprojnë me njerëzit”. Ndërsa softueri për pajisjet robotike po përmirësohet, hardueri tani po bëhet faktori kufizues, thonë studiuesit, veçanërisht kur bëhet fjalë për robotët humanoidë. “Por për sa i përket trurit të robotëve”, thotë doktor Chen, “Ne po bëjmë përparim shumë të shpejtë në inteligjencë”./Monitor